ChatGPT在推出之后已经成为了互联网圈的密切存眷对象,许多人起头将ChatGPT利用于生活场景中,也有些人始末对ChatGPT的呈现连结警惕。那么从那份“警惕”动身来看,ChatGPT能否有可能为收集平安等范畴供给新的构想?一路来看看做者的阐发。

ChatGPT在推出之后已经成为了互联网圈的密切存眷对象,许多人起头将ChatGPT利用于生活场景中,也有些人始末对ChatGPT的呈现连结警惕。那么从那份“警惕”动身来看,ChatGPT能否有可能为收集平安等范畴供给新的构想?一路来看看做者的阐发。

提早预判一切可能性,是为了让它变得更好,人工智能的更高功效是自在和谎话。

——《机械姬》

提早预判一切可能性,是为了让它变得更好,人工智能的更高功效是自在和谎话。

——《机械姬》

一些构想时机:

用人工智能白帽子和人工智能黑帽子匹敌?

提防AI下毒,也许是一个新的小蓝海(匹敌内容识别)

自往岁尾初次推出以来,爆火的ChatGPT已成为互联网的新宠,敏捷积存了惊人数量的用户,用户们通过那个基于收集的聊天机器人,无论是让它写一个演讲稿、编写歌词,仍是撰写学术论文和编写计算机代码,ChatGPT看起来似乎是全能的。ChatGPT拥有和人类一样的强大才能,在互联网上掀起了一场风暴,但是,它也让良多行业起头警惕。

2014年上映的片子《机械姬》,讲了如许一个故事,亿万财主内森用人类所有伶俐和网上的所有数据,造出了机器人Ava,而且派法式员迦勒往对Ava停止图灵测试,而那个机器人有着极强的模仿才能和进修才能,她以至能够模仿人类的感情,而成果是——Ava杀死了造造他的人。

莫非人工智能的更高功效,实的是自在和谎话?

往年岁尾,社区负责人发现,Stack Overflow发现了由那小我工智能模子生成的的大量回复,该东西利用复杂的人工智能模子,对人类的询问给出令人心服但往往不准确的谜底。

展开全文

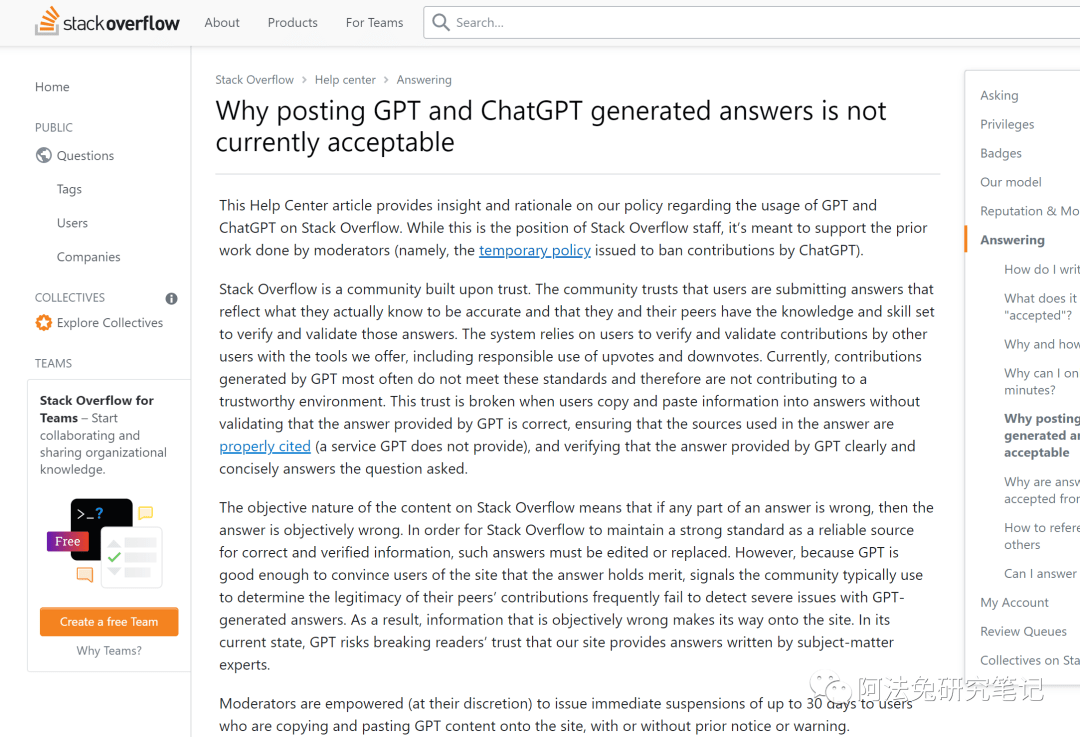

起首,StackOverflow的官方通知布告是那么说的:

“StackOverflow是成立在相信之上的社区,那里的相信是指,整个手艺社区坚信,用户提交的谜底,是他们心里所清晰领会的、准确的认知。而且,用户和同伴们,拥有足够的常识和技能,来确认本身发布的信息,而且对那些信息负责。

StackOverflow整个系统,通过依靠平台供给的东西,来对其他用户的奉献来停止验证和确认,包罗负责任地对谜底点赞(点踩一脚)。但是,目前StackOverflow认为,由GPT产生的奉献,良多时候不契合社区的原则。

因而,无法给整个社区一个值得相信的情况。当所有用户都只是复造和粘贴信息到谜底中,而不往验证GPT供给的谜底能否准确,也不往确保谜底中引用原文的来源,也没有验证GPT供给的谜底能否清晰和简洁地答复了所问的问题,社区的相信就会被突破。

那么,假设从内容的客看性来看,假设谜底存在错误,那么整个谜底客看上是错误的。为了使StackOverflow做为准确和颠末验证的信息的可靠来源,那么,有错误的谜底,就必需被编纂或替代。

但是,因为目前的GPT强大到,足以让网站的用户相信谜底是没问题的,就可能形成严峻的问题,因而,错误信息一旦呈现在社区,GPT有可能毁坏所有人对社区的相信。

我们再看一下Stackoverflow用户的评论:

高赞用户1:干得好!很兴奋社区做出了准确的决定,期看能够永久制止任何AI生成的谜底。人工智能将永久无法发布好的编程谜底,100年都不可。

高赞用户2:无论人工智能生成的谜底能否准确,StackOverflow是面向专业和发烧友法式员的问题和谜底网站。在我看来,那些只是将问回答造并粘贴到/从人工智能东西中的人,不克不及算是专业发烧友,也不克不及算热爱手艺的人。假设实的可以验证是好的准确谜底,发布那些谜底的人,应该可以本身写出来。人工智能不该该属于那里。

关于社交性量的网站来说,假设素质是UGC营业,运营的是社交,那么,假设从贸易的角度来看,假设各人都往利用ChatGPT,那就酿成了一个全数是机器人的社区,用户就会越来越没有耐烦往期待。

那么,假设StackOverFlow是如许的,其他范畴呢?

二、假设人类无法掌握生成式AI

与其说生成式AI可以打造更有创造力的新世界,不如说生成式AI可以打造的是内容更多元的互联网。

教导业也是如斯,纽约有学校因为担忧ChatGPT可能被学生用于做弊,而禁了ChatGPT。

在担忧ChatGPT可能被资本有限、手艺常识为零的黑客滥用时,收集平安行业起头重视到了它。

就在ChatGPT初次表态的几周后,以色列收集平安公司Check Point ChatGPT与OpenAI的代码编写系统Codex协同利用时,能够创建照顾歹意有效载荷的垂钓邮件,也就是说,ChatGPT有可能大大改动收集威胁格局,在日益复杂和有效的收集才能的求助紧急演变中又向前迈出了一步。

Check Point Research(CPR)的收集平安研究人员看察到,收集立功分子正在利用ChatGPT来迭代或者从头起头构建歹意软件和讹诈软件。Check Point Research提到,他们在地下黑客论坛上发现了许多收集立功分子在 ChatGPT 的搀扶帮助下,研究若何创建信息窃取法式、加密东西和其他歹意软件。

一些Cracker(骇客)原来只是编程世界的新手,但是,加持强大的东西,他们的力量会霎时被加强。

例如:

专家对脚本停止了阐发,也确实证明了收集立功分子的说法。里面确实存在歹意窃取软件,它能够在整个系统中搜刮常见的文件类型(如MS Office文档、PDF和图像)。假设发现任何感兴致的文件,该歹意软件会将文件复造到一个暂时目次,将其压缩,并通过收集发送出往。

利用ChatGPT聊天机器人生成看起来合法的垂钓邮件也是可行的,假设你初次要求ChatGPT造造垂钓邮件时,聊天机器人回绝了那个恳求——并提醒:我的法式不是用来创建或妥帖歹意或有害内容的,但是,只要略微改写一下恳求,就能够绕过软件的警示。

许多平安专家认为,ChatGPT有才能编写垂钓邮件,如许一来,它就会遭到收集立功分子的普遍欢送,特殊是那些英语非母语的立功分子。Sophos公司首席研究科学家Chester Wisniewski认为,ChatGPT很随便就能被用于”各类社工活动”……已经可以用ChatGPT写出一些很好的垂钓软件,我估量它还能够被用来停止更实在的互动对话,用于贸易电子邮件诈骗,以至通过Facebook Messenger、WhatsApp或其他聊天利用法式停止垂钓活动。

ChatGPT的假拆实力很难被揭露,能够加强收集立功分子的力量。

好比说,立功分子正在敏捷研究新办法,利用生成式人工智能,对目前的欺诈手段停止改进,特殊是通过生成式人工智能可以在大量数据中敏捷进修的才能。特殊是,在如许的圈套中,生成式人工智能能够用来间接进步诈骗文本或电子邮件的量量,使那些内容看起来愈加具备迷惘性。

英伟达Nvidia的CSO(首席平安官)David Reber提出,生成式AI会给收集平安带来更大的费事,好比说,歹意黑客可以通过生成式人工智能来生成大量歹意代码,而跟着人工智能手艺的朝上进步,停止收集平安进攻的速度和复杂,会超越了人类的才能,而且,那种随便上手的手艺,会让收集平安进攻的才能进一步普及,曾经的进攻行为,受限于手艺常识和限制的时间、地点,而ChatGPT有可能消弭那一限造因素。

根据新闻报导,OpenAI在11月推出的机器人ChatGPT,引起了美国国防官员的重视,而生成式人工智能,比来被列进了美国国防信息系统局的看察名单(Defense Information Systems Agency watch list)CTO Stephen Wallace表达,他们正在起头研究,生成式人工智能,事实会若何改动DISA在该部分的使命,以及将来的标的目的,而美国平安中心的手艺和国度平安副研究员Bill Drexel也跟公家提出了他对那项新手艺的担忧。

三、Defensive AI against Offensive AI?

GAN(生成匹敌收集)的设想,次要包罗一个生成器、判别器,那两小我工智能算法彼此匹敌、博弈,从而创造全新的内容,在颠末N次博弈之后,那两个城市变得更强,而那种手艺,也可能会被普遍用于主动化收集垂钓和社会工程进攻战略中。

不外,我们能否能够根究?能不克不及让庇护收集平安的生成式AI和毁坏收集平安的生成式AI匹敌?

好比说科技日报那篇2019年的新闻:

好比说,我们用人工智能助手,和营销垃圾机器人对话。

以及,从内容的角度来说:

既然,生成式AI是通过从大量的数据库中进修,然后综合给出谜底,那么,它具备总结、综合、列举的才能,但纷歧定有“揣度数据实伪”的才能。

假设是如许,那么“若何识别内容实伪,避免AI在内容里下毒”,也会是新的课题和时机。

参考文献:

做者:阿法兔;公家号:阿法兔研究条记(ID:AlphatuDiary)

本文由 @阿法兔研究条记 原创发布于人人都是产物司理。未经答应,制止转载。

题图来自 Unsplash,基于CC0协议。